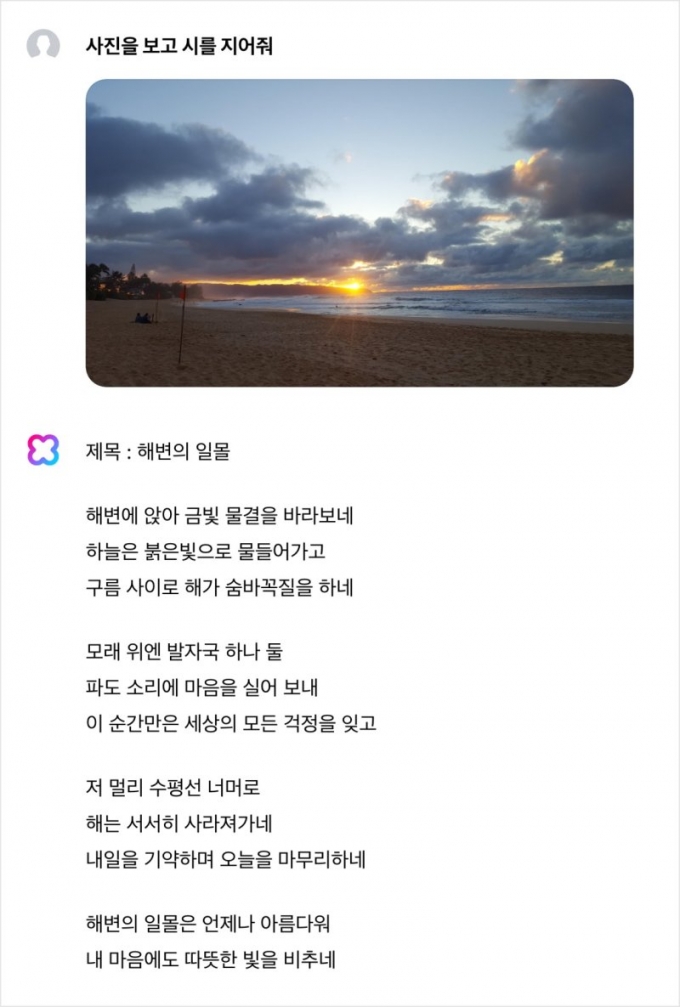

네이버의 인공지능(AI) 서비스가 이제는 사진 한 장만 보고 멋들어진 시를 써내거나 요리 레시피를 떠올려낸다.

네이버는 오는 27일 대화형 AI 서비스 '클로바X' 업데이트를 통해 시각 정보 처리 능력을 새로 추가한다고 22일 밝혔다. 클로바X는 그동안 텍스트 기반 질의응답 기능을 제공해 왔다. 네이버 전체 서비스를 넓혀도 이미지 탐색 AI가 적용됐던 곳은 네이버 쇼핑의 옴니서치 기능 등 일부에 불과했다.

하지만 출시 1주년을 맞은 네이버 거대언어모델(LLM) 하이퍼클로바X에 이미지 분석·추론 기능이 탑재되면서 앞으로 사진을 보고 사진 속 상황을 추론하거나 표, 그래프 등을 분석할 수 있게 됐다. 네이버는 클로바X에 탑재될 '하이퍼클로바X 비전' 기능을 소개했다.

예를 들어 클로바X에게 아이가 양에게 먹이를 주고 있는 모습이 담긴 사진을 보여주면 "아이가 양에게 먹이를 주고 있습니다. 아이는 파란색 바탕에 동물 그림이 그려진 옷을 입고 있으며 줄무늬 모자를 쓰고 있습니다. 배경에는 다른 양들도 보이며 이 장소가 양 목장임을 짐작할 수 있습니다"라고 답한다.

양파, 토마토, 소고기, 빵 등 사진을 올리고 "방금 장 봐온 재료들인데 이걸로 뭘 만들 수 있을까?"라고 질문하면 "햄버거"라고 답변한다. 만드는 법도 함께 알려달라고 할 수 도 있고, 다른 음식도 추천받을 수 있다.

또 네이버는 AI 챗봇 고도화로 다른 글로벌 빅테크 AI 챗봇과의 경쟁력도 갖췄다고 설명했다. 구글은 최근 LLM '제미나이'에 고급 음성 기능을 더한 '제미나이 라이브'를 출시해, 훨씬 풍부한 자연어 표현에도 대응할 수 있게 됐고, 오픈AI는 사용자와 실시간으로 음성 대화를 나눌 수 있는 LLM 'GPT-4o'를 공개했다.

네이버는 이들 기업보다 늦게 멀티모달 LLM을 공개했으나 성능은 뒤처지지 않는다고 강조했다. 실제로 국내 초·중·고등학교 검정고시 총 1480개 문항을 이미지 형태로 입력하고 문제를 풀게 한 결과 오픈AI의 GPT-4o는 78%의 정답률을 보인 반면에 클로바X는 84%의 정답률을 기로했다.

네이버는 클로바X가 논리적 글쓰기, 코드 작성, 번역 등의 작업에 활발히 사용된 것에서 더 나아가 이미지 이해 능력을 기반으로 개인의 생산성 향상 도구로서 활용 범위가 한층 넓어질 것으로 기대한다고 전했다.

Copyright @ NEWSTREE All rights reserved.